OpenClaw保姆级别安装教程,小白也可以养好自己的小龙虾

完全不会敲代码的小白,只要会复制粘贴命令,就能在自己电脑上养一只会干活的“小龙虾”(OpenClaw)

文章目录

完全不会敲代码的小白,只要会复制粘贴命令,就能在自己电脑上养一只会干活的“小龙虾”(OpenClaw)。

一、先搞清楚:OpenClaw 是什么?

先别急着装环境、跑脚本,先把这只“虾”看明白,后面所有操作才有数。

一句话:OpenClaw 是一个开源的、本地优先的 AI 智能体框架,可以直接 接管电脑 帮你真实干活的数字员工。

详细点说:

- 它不是一个单纯的大模型,而是一个 AI Agent(智能体)执行框架:可以理解自然语言指令,自动拆解成任务计划,通过 Skills 和 工具调用 去真正执行操作。

- 它可以部署在个人电脑(Windows / macOS / Linux)、云服务器、私有服务器(阿里云、腾讯云、百度智能云等)。

- 本地优先:服务跑在自己的机器上,文件、操作日志、配置等默认 存在本地或自己的节点,不是某家云厂商的服务器。支持私有化部署,做内网环境和数据合规控制。

项目GitHub 地址: https://github.com/openclaw/openclaw

可以把它当成一个 7×24 小时在线、不用社保、可以随时扩展技能的 数字打工人!只要给了指令,会 自己上去把事做了。

都用过 ChatGPT、Kimi、豆包之类的大模型服务吧,OpenClaw 和它们的差别:

| 对比 | 普通 AI | OpenClaw |

|---|---|---|

| 核心作用 | 聊天、问答、写文案、写代码 | 执行任务、操控电脑、自动化工作流 |

| 交互方式 | 浏览器、官方 App | 飞书、钉钉、QQ、Telegram、WhatsApp 等聊天工具 里直接对话 |

| 数据位置 | 厂商云端 | 本地或私有云节点,数据可控 |

| 执行能力 | 提供 怎么做 的方案 | 直接 打开软件、读写文件、发邮件、跑脚本、填表单 |

| 定制扩展 | 功能由平台决定,很难自定义 | 开源代码 + Skills 生态,可以自己写、自己装新能力 |

几个直接想象到的使用场景:

- 把桌面上所有 PDF 按修改时间整理好,按年份分目录归档。

- 每天晚上 10 点,帮整理一下今天的邮件,生成摘要发到 QQ。

- 把这个项目部署到服务器上,并把部署日志发飞书。

OpenClaw 背后还是各种大模型,但它自己是一个 执行外壳 + 网关 + 技能系统。

OpenClaw 能做到的,可以分为几大类能力:

(1)文件 & 磁盘操作

- 按规则整理文件夹(按日期、类型、项目归档)。

- 批量重命名、格式转换。

- 扫描、分类、打包日志和报告。

(2)系统和终端操作

- 运行脚本、命令行任务。

- 自动化部署项目、拉取代码、跑测试。

- 基于自然语言生成命令并执行。

(3)邮件 & 日程 & 通讯工具

- 清理收件箱、按主题分类、生成摘要。

- 帮发邮件、发 IM 消息。

- 维护个人或团队日历,自动创建提醒任务。

(4)多平台接入 & 网关能力

- 通过 Telegram、WhatsApp、Slack、Discord、Signal、iMessage、飞书、钉钉、企业微信、QQ 等和它对话。

- 一个统一网关调度不同模型、不同通道、不同 Skills。

(5)自定义 Skills 扩展

- 官方和社区已经有数百个现成技能(文件管理、知识库、自动化操作等)。

- 可以自己写一个 skill.

这也是为什么媒体会形容它是“线上版贾维斯”、“能指挥电脑的数字员工”。

还有,官方名字叫 OpenClaw,为啥大家都叫它“小龙虾”?

把名字拆开看:Open + Claw。

- Open:代表开源(Open Source),开放生态、代码可改、框架可扩展。

- Claw:英文是 “爪子 / 钳子” 的意思;在项目语境里,指的就是 “龙虾钳子”,操作电脑、抓文件、点按钮。

所以,从纯字面上,“OpenClaw”就可以理解成:

开源的龙虾钳:一个有爪子、能动手的开源智能体。

项目的官方 Logo 和吉祥物,本身就是一只非常显眼的 红色小龙虾。

视觉形象 + 名字谐音,二者一叠加,第一眼就把它叫成了“小龙虾”。

OpenClaw 还有一段改名史:

最初版本叫 Clawdbot, 是奥地利开发者 Peter Steinberger 在周末写出来的项目雏形,名字是对大模型 Claude 的谐音:Clawd ≈ Claude,同时又保留 Claw 的元素。然而,项目一夜之间在 GitHub 爆红,Star 暴涨。

因为名字和 Anthropic 的 Claude 太像,收到了对方法务团队的“友好提醒”,团队就临时把名字改成 Moltbot:Molt 是“蜕壳”之意,刚好是龙虾成长时会做的事;意味着“龙虾脱壳重生”,非常符合那段尴尬又戏剧化的改名期。

2026 年 1 月 31 日,项目正式定名为 OpenClaw。 “Claw” 保留龙虾吉祥物和项目的传统,“Open” 强调这是一个真正开源、社区驱动的基础设施项目。 这次更名也标志着项目完全摆脱和商业模型的商标纠葛,独立成一个开源品牌。

除了叫“小龙虾”,大家还爱说自己是“养虾人”。这个说法主要有两点:

- 部署 & 调试过程像在 养成: 要给它 运行环境、接入大模型、设置权限、装技能;用得越久,它的记忆、偏好和工作流越完善,就像养成一个越来越懂你的助手!

- 大模型离不开 Token: 让它多干活,就会消耗更多大模型 Token,要不断喂它 Token,它才能不断成长。

所以,“部署 / 配置 / 喂 Token / 训练工作流”这一整套动作,也就戏称为 “养龙虾” ,也很好玩。

二、养虾前检查一下:你的电脑够不够格?

在动手安装 OpenClaw 之前,要先确认机器到底能不能安装的下!。

硬件不达标,轻则卡顿和莫名其妙报错,重则直接跑不起来。

要搞清楚三件事:

- 打算让龙虾干到什么程度(只当“云模型管家”,还是要在本地跑大模型)。

- 不同玩法对电脑配置的要求。

- 怎样快速检查自己的电脑是否达标,以及不达标时怎么选方案。

从硬件角度看,OpenClaw 主要有两种玩法:

- Gateway 模式(推荐入门): 大模型推理都在云端,本地机器只负责 收消息、调用 API、跑一些脚本和浏览器自动化。这个模式的特点是 对本机算力要求低,对网络稍微敏感一些。

- 本地模型模式: 把 Llama、Qwen 等大模型直接下载到本机或服务器上跑。对内存、CPU、GPU、磁盘要求高得多;配置越高,能跑的模型越大、越顺畅。

所以:

是 只想先玩 Gateway,还是一上来就要冲本地大模型?

不用太纠结配置,只要满足下面这几个条件,大概率没问题!这张表比单纯官方“能跑”的最低标准更贴近日常使用体验。

| 项目 | 入门:只玩 Gateway 模式 | 进阶:Gateway + 浏览器自动化 | 高阶:本地跑大模型 |

|---|---|---|---|

| CPU | ≥ 1 核 / vCPU | 2–4 核 / vCPU | 桌面机:i5 / Ryzen 5 级别 4–8 核 或服务器:4–8 vCPU |

| 内存(RAM) | 能跑起来:1 GB 现实最低:2 GB |

4–8 GB(每开一个浏览器要 2–4 GB) | 16 GB 起步,32 GB 更舒服;70B+ 模型建议 64 GB+ |

| 磁盘空间 | 最少 500 MB 推荐 2–10 GB SSD |

20–40 GB SSD | 模型 + 日志建议 50 GB+,长期运行 80–160 GB 更稳 |

| 硬盘类型 | 推荐 SSD | NVMe SSD 更快 | 必须 SSD / NVMe,HDD 会严重拖慢加载 |

| GPU(仅本地模型) | 不需要 | 不需要 | 7–8B 模型:≥ 8 GB VRAM 13B:建议 16–24 GB VRAM 70B:48–80 GB VRAM |

| 操作系统 | Ubuntu 22.04+/Debian 12、macOS 原生;Windows 要 WSL2 | 同左 | 同左(服务器推荐 Ubuntu 22.04 LTS 或 Debian 12) |

| Node.js | ≥ 22 | ≥ 22 | ≥ 22 |

| Docker | 可选 | 推荐 | 用 Docker 跑服务 |

表格信息太多,看不懂?没事,一句话:

- 只玩 Gateway:2 GB 内存 + 一点 SSD 就够了。

- 要浏览器自动化、多通道聊天:至少 4 ~ 8 GB 内存。

- 想在本地跑大模型:16 ~ 32 GB 内存 + 充足 SSD +(最好有)带 8 ~ 24 GB 显存的显卡。

个人电脑:

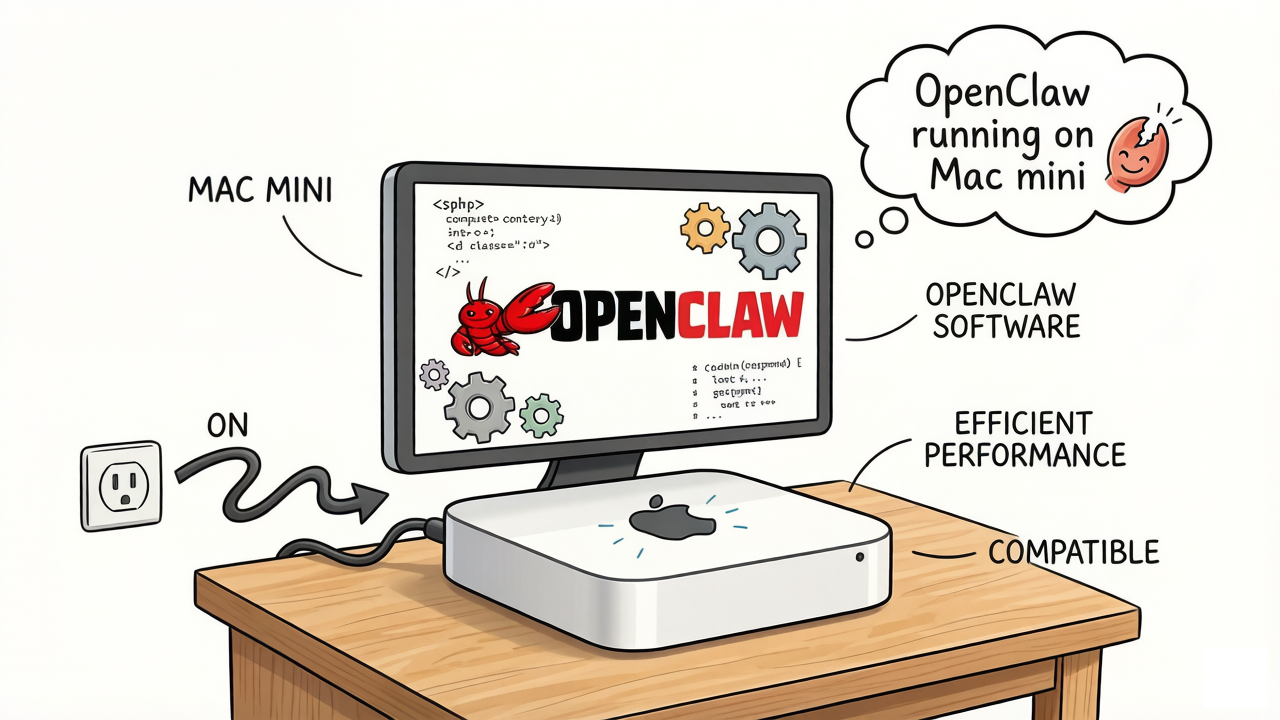

(1)macOS:Mac Mini / Mac Studio。

- Mac Mini M4 / 16 GB 适合Gateway + 8B 左右模型本地推理尝鲜。

- Mac Mini M4 / 32 GB 适合日常使用 8–13B 模型、并发通道稍多。

- Apple Silicon 的统一内存 + Ollama 等工具,跑本地模型体验比较好。

(2)Windows / Linux 台式机、笔记本。

- CPU:近几年的 i5 / Ryzen 5 及以上。

- 内存:只玩 Gateway的话 8 GB 足够宽裕。想本地模型:直接上到 16–32 GB 会省心很多。

- 硬盘:有一块 256 GB 以上 SSD 就不会太紧张。

- 显卡(想玩本地大模型再考虑):

- 7–8B:NVIDIA 8–12 GB 显存(RTX 3060 之类)。

- 13B:16–24 GB 显存在体验上更像 能用 而不是 能跑起来。

OpenClaw 目前是 Linux/macOS 原生优先,Windows 官方推荐通过 WSL2 跑 Ubuntu。

安装步骤是:

- 管理员模式打开 PowerShell,执行

wsl --install安装 WSL2; - 安装 Ubuntu‑24.04:

wsl --list --online查可用版本,wsl --install -d Ubuntu-24.04; - WSL 内开启

systemd,否则 Gateway 服务装不上; - 再在 WSL 里按 Linux 方式安装 OpenClaw。

如果是 Windows,又不愿意折腾 WSL2,那就更适合选 云 VPS 部署 或 买一台小型 Linux 机/ Mac Mini 当专用机。

(3)对于 树莓派 & 迷你主机:

- Raspberry Pi 5(8 GB 版), 便宜、省电、全天候开机。只跑 Gateway + 云模型,不建议在上面硬跑本地大模型。存储最好配 NVMe SSD(通过官方 M.2 扩展板),不要指望 MicroSD 扛长期读写。

- 迷你主机(Mini PC) 最常见配置是 Ryzen 5 / Intel i5 + 16 GB 内存 + 512 GB NVMe SSD,功耗低、噪音小,适合作为家用“小龙虾工作站”常年开机。优点是 一次性硬件投入,长期不用付 VPS 月费。

想要稳定在线、外网可访问、省事,可以直接上 VPS。

- 最低可用配置(单人玩、轻任务):2 vCPU + 4 GB RAM + 40 GB SSD,Ubuntu 22.04 LTS,Docker 24+ 即可。

- 推荐配置(浏览器自动化 + 多人或多通道):4 vCPU + 8 GB RAM + 80–160 GB SSD。

- 长期生产环境 建议一开始就选 80 GB–160 GB NVMe SSD,给日志、下载、Python 环境留空间。

自检清单:

(1)OS & 运行环境:

- 系统是:

- Ubuntu 22.04+ / Debian 12 / macOS 13+,或

- Windows + 已安装 WSL2 + Ubuntu‑24.04,并已开启 systemd。

-

node -v显示的版本 ≥ 22。 - (可选)

docker --version正常输出,版本在 24.0+ 以上。

(2)CPU & 内存:

- CPU 至少有 2 个逻辑核心(

lscpu | grep "CPU(s)")——只玩 Gateway; - 如果要玩浏览器自动化或同时跑多个通道,最好 4 核及以上;

-

free -h显示:- 只玩 Gateway:总内存 ≥ 2 GB;

- 要浏览器自动化:≥ 4–8 GB;

- 要跑本地模型:≥ 16 GB(32 GB 更推荐)。

(3)存储:

-

df -h /显示根分区空余:- 只玩 Gateway:至少 5–10 GB 空间;

- 加浏览器自动化和日志:20–40 GB;

- 本地模型:50 GB+(模型文件 + 缓存 + 日志),长期运行建议 80–160 GB。

- 确认是 SSD / NVMe,不是机械硬盘(查机器配置)。

(4)GPU(如果打算跑本地大模型):

-

lspci | grep -i "VGA"能看到 NVIDIA 显卡信息; - 显存容量满足对应模型级别:

- 7–8B 模型:≥ 8 GB VRAM;

- 13B 模型:≥ 16–24 GB VRAM;

- 30B+ 模型:≥ 24–48 GB VRAM;

- 70B+:48–80 GB VRAM。

如果不够格怎么办?有几条现实可行的路:

(1)内存不足(≤ 4 GB)

- 只想体验一下:可以在现有机器上跑最基础的 Gateway(2 GB 也能用),但一定要控制并发和任务复杂度。

- 想长期稳定:桌面机/笔记本能加内存就加到 8–16 GB;或者转用云 VPS。

(2)没有 SSD 或空间特别紧(< 10 GB)

- 快速方案:清理磁盘、迁移个人文件,保证最少 10 GB 空间留给系统 + OpenClaw;

- 从长期看:建议上 SSD 或增加硬盘容量,尤其是想跑本地模型。

(3)Windows 不想折腾 WSL2

- 直接租一台便宜 VPS(2 vCPU + 4 GB RAM + 40 GB SSD),照着下面的 Linux 教程走;

- 或买一台迷你 Linux 主机 / 二手 Mac Mini 专门用来“养虾”。

(4)想跑本地大模型但预算有限

- 优先把钱花在:内存(16–32 GB) + SSD 容量(512 GB 左右),GPU 可以后面再加;

- 或选 Mac Mini M 系列 16–32 GB 内存,搭配 Ollama 等做高性价比本地推理。

三、养虾总流程一图看懂

整个过程是 9 个串起来的小步骤:

- 确认机器配置。

- 安装基础环境(Node.js + Git,可选 Docker / WSL2)。

- 获取并安装 OpenClaw。

- 启动 OpenClaw 服务。

- 运行 onboard 配置向导。

- 接入大模型(云端 / 本地)。

- 给龙虾“装技能”(Skills)。

- 配置对话入口(飞书、QQ、企业微信 等通道)。

- 发一条测试指令,确认开始干活。

主要是:

- 安装基础环境(Node.js + Git + 可选 Docker)。

- 安装 OpenClaw,常见有 3 条路线:脚本一键安装、Docker / docker-compose 安装、图形安装器 / 第三方一键包。

- 运行 onboard 配置向导(新手必走)。

- 接入大模型。

- 安装 Skills。

- 配置对话入口(聊天网关):QQ / 微信企业号 / 钉钉 / 飞书。

后面的章节会把其中几步拆开详细讲。

四、安装基础环境

主要是:

- Node.js(必须是 22 及以上版本)

- Git(任意较新版本即可)

只要这一关过了,后面 一键安装 OpenClaw、本地跑服务、装技能 才不会到处报红字。

先搞清楚:为啥一定要装 Node.js 和 Git?

没有 Node.js,OpenClaw 根本起不来;没有 Git,后面拉代码、装技能都会很麻烦。

| 组件 | 它干嘛用 | 对 OpenClaw 的影响 |

|---|---|---|

| Node.js | JavaScript 运行时环境 | OpenClaw 核心服务、控制逻辑都跑在 Node 上,版本太低会直接跑不起来 |

| npm / pnpm 等包管理器 | 管理依赖包 | 安装/升级 OpenClaw 及其依赖,用来拉各种库 |

| Git | 代码版本管理工具 | 从 GitHub 拉 OpenClaw 源码/发行包,安装/更新社区 Skills |

基础要求:

| 项目 | 最低要求 | 推荐 |

|---|---|---|

| Node.js | 22.x 及以上(必须) | 用官方 22 LTS 版本 |

| npm | 随 Node 22 自动安装 | 保持系统自带即可 |

| Git | 2.x 及以上 | 用系统包管理器/官方安装包安装 |

后面所有检查,都会围绕三条命令展开:

node -v

npm -v

git --version

如果是在:

- 云服务器(大多是 Ubuntu/Debian)

- WSL 里的 Ubuntu

- 自己装的桌面 Linux

推荐用 NodeSource 源 或 nvm,这样能拿到 Node 22。

(1)用 NodeSource 安装 Node.js 22 + Git 是最简单的:

# 1)添加 NodeSource 官方源

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

# 2)安装 Node.js + Git

sudo apt update

sudo apt install -y nodejs git

# 3)验证版本

node -v # 输出 v22.x.x

npm -v

git --version

如果 node -v 输出小于 22,说明源没配置好或装错版本,可以重新执行以上步骤。

(2)用 nvm 安装,适合开发者;想要同一台机器上跑多版本 Node,推荐这条路线。

# 1)安装 nvm(Node 版本管理工具)

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.7/install.sh | bash

# 2)重新打开一个终端,或者手动加载配置

source ~/.bashrc # 或 ~/.zshrc 等

# 3)通过 nvm 安装 Node.js 22 LTS

nvm install --lts=hydrogen # 如果官方名为 22 LTS

# 或者

nvm install 22

nvm use 22

nvm alias default 22 # 设置为默认版本

# 4)安装 Git(如果还没装)

sudo apt update

sudo apt install -y git

# 5)验证

node -v

npm -v

git --version

提示:以后如果 Node 有大版本升级,只要

nvm install 新版本 && nvm use 新版本即可,不会影响系统其它软件。

macOS 上最省心的方式是用 Homebrew。

# 1)更新 Homebrew

brew update

# 2)安装 Node 和 Git

brew install node git

# 3)确认版本

node -v

npm -v

git --version

如果之前装过老版本 Node,可以:

brew upgrade node

让 Homebrew 升级到较新版本,再检查是否到 22 及以上。

Windows的话,要先搞定 WSL2,再在 WSL 里装。

OpenClaw 官方更推荐在 Linux 上跑,因此 Windows 用户的主线玩法是:

Windows 安装 WSL2,在 WSL 的 Ubuntu 里装 Node.js + Git,再部署 OpenClaw。

下面就介绍 安装 WSL2 + Ubuntu,让 Windows 系统也能晚上 OpenClaw。

(1)管理员身份打开 PowerShell,执行:

wsl --install -d Ubuntu-24.04

安装完成后,重启电脑。然后在开始菜单里打开 “Ubuntu”,设置用户名和密码。

(2)接下来所有命令,都在 Ubuntu(WSL)终端 里执行:

# 1)添加 NodeSource 源并安装 Node.js 22

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

sudo apt update

sudo apt install -y nodejs git

# 2)验证版本

node -v

npm -v

git --version

小贴士:如果后面打算用浏览器访问 OpenClaw 的 Web 控制台,记得用

localhost:端口即可,Docker/WSL 会负责中间的网络转发。

常见小坑和排查思路:

| 情况 | 可能原因 | 解决办法 |

|---|---|---|

node: command not found |

安装失败或 PATH 未更新 | 重新跑安装命令,或重启终端 / 机器;nvm 要 source ~/.bashrc |

node -v 显示 v18 / v20 |

系统自带老版本 | 安装 nvm,用 nvm install 22 && nvm use 22,并设为默认 |

git: command not found |

未安装 Git | sudo apt install git / brew install git / Windows 走 git-scm 安装器 |

| Windows 能在 CMD 里跑 Node,但 WSL 里找不到 | 装在 Windows 系统里了,WSL 是另一套环境 | 记住:OpenClaw 的所有安装都在 WSL 的 Linux 里进行 |

五、一键安装 OpenClaw

结合官方文档和社区实践,现在比较主流的几种安装方式是:

| 方式 | 适合人群 | 特点 |

|---|---|---|

| 官方一键脚本(推荐) | 大多数新手、个人开发者 | 一条命令搞定 Node 检测 + OpenClaw 安装 + 可选 onboard |

| npm/pnpm 全局安装 | 已熟悉 Node 生态的用户 | 自己控制版本和路径,适合已有 Node 环境的开发者 |

| Docker 部署 | VPS、NAS、迷你主机,想隔离环境的人 | 环境干净、易迁移、适合长期运行 |

| 从源码构建 | 想改代码、参与开发的人 | 要 pnpm 等,步骤较多 |

对于小白来说:就选 官方一键脚本。

5.1、官方一键脚本安装

适用系统:

- macOS(Apple 芯片 / Intel 都可以)。

- 各种 Linux(Ubuntu、Debian 等)。

- Windows WSL2 的 Ubuntu。

脚本会自动完成:

- 检测当前 Node 版本(不足 22 就帮装或提示)。

- 用

npm全局安装openclaw最新稳定版。 - 默认拉起一次 onboard 向导(可关闭)。

macOS / Linux / WSL2 直接运行:

# 标准安装:包含自动 onboard

curl -fsSL https://openclaw.ai/install.sh | bash

安装完成后,会看到类似输出:

🦞 OpenClaw Installer

I run on caffeine, JSON5, and the audacity of "it worked on my machine."

✓ Detected: linux

Install plan

OS: linux

Install method: npm

Requested version: latest

[1/3] Preparing environment

✓ Node.js v22.22.1 found

· Active Node.js: v22.22.1 (/usr/bin/node)

· Active npm: 10.9.4 (/usr/bin/npm)

[2/3] Installing OpenClaw

✓ Git already installed

· Configuring npm for user-local installs

✓ npm configured for user installs

· Installing OpenClaw v2026.3.8

✓ OpenClaw npm package installed

✓ OpenClaw installed

[3/3] Finalizing setup

! PATH missing npm global bin dir: /home/flu/.npm-global/bin

This can make openclaw show as "command not found" in new terminals.

Fix (zsh: ~/.zshrc, bash: ~/.bashrc):

export PATH="/home/flu/.npm-global/bin:$PATH"

如果只想先 装好不配置,可以加一个参数跳过 onboard:

curl -fsSL https://openclaw.ai/install.sh | bash -s -- --no-onboard

--no-onboard的意思是:先只装程序本体,onboard 向导单独跑一次。

5.2、npm / pnpm 手动安装

已经装好了 Node 22+,也可以不用脚本,自己安装:

(1)用 npm 安装:

# 1)全局安装 OpenClaw

npm install -g openclaw@latest

# 2)第一次初始化 + 安装守护进程

openclaw onboard --install-daemon

如果安装时 sharp 报错,官方建议增加一个环境变量再安装:

SHARP_IGNORE_GLOBAL_LIBVIPS=1 npm install -g openclaw@latest

(2)用 pnpm 安装:pnpm 安装会更快一些,但要手动批准带构建脚本的依赖。

# 1)用 pnpm 安装

pnpm add -g openclaw@latest

# 2)批准构建脚本(node-llama-cpp、sharp 等)

pnpm approve-builds -g

# 3)执行 onboarding + 安装守护进程

openclaw onboard --install-daemon

小贴士:pnpm 第一次安装时,会提示“忽略了构建脚本”,按上面执行

pnpm approve-builds -g即可。

5.3、Docker 部署

如果是:

- 云服务器 / VPS 用户(阿里云、腾讯云、国外 VPS 等)

- 有一台长期开机的 NAS / 迷你主机,希望环境彻底和宿主机隔离

可以直接用官方 Docker 镜像部署。

确认 docker --version 正常输出,且服务已启动:

sudo systemctl status docker

没有 Docker 的话,按各发行版官方文档装好即可(这里就不展开了)。

然后拉取并运行容器:

# 1)拉取最新稳定版镜像

docker pull openclaw/openclaw:latest

# 2)启动容器

docker run -d \

--name openclaw \

-p 8080:8080 \

-v $HOME/.openclaw:/root/.openclaw \

-v $HOME/openclaw-data:/root/openclaw-data \

openclaw/openclaw:latest

-p 8080:8080:把容器内的 8080 端口映射到宿主机 8080,后面可以通过http://服务器IP:8080打开 Web 控制台。-v:把配置和数据挂载到宿主机目录,方便备份和迁移。

在容器内跑 onboard:后面章节会详细讲。

# 进入容器

docker exec -it openclaw /bin/bash

# 容器内执行(和本机一样)

openclaw onboard --install-daemon

5.4、从源码安装

如果要修改 OpenClaw 源码或参与贡献,可以从 GitHub clone 源码自己构建:

# 1)拉代码

git clone https://github.com/openclaw/openclaw.git

cd openclaw

# 2)安装依赖并构建

pnpm install

pnpm ui:build

pnpm build

# 3)把 openclaw CLI 链接到全局

pnpm link --global

# 4)执行 onboarding

openclaw onboard --install-daemon

不想全局 link 的话,也可以在仓库目录直接用:

pnpm openclaw onboard --install-daemon

5.5、安装完成后的自检

不管是用脚本、npm/pnpm 还是 Docker,安装成功之后,最好做一遍健康检查:

# 1)确认命令存在 & 能输出版本

openclaw version

# 2)运行健康检查

openclaw doctor

# 3)查看网关/守护进程状态

openclaw status

# 4)尝试打开 Web 控制台(浏览器地址栏)

openclaw dashboard # 会自动打开浏览器

# 或手动在浏览器访问:

# http://localhost:8080

5.6、常见问题

(1)openclaw: command not found,原因: npm 全局安装路径不在 PATH 中。

检查:

node -v

npm -v

npm prefix -g

echo "$PATH"

如果 $(npm prefix -g)/bin 没在 PATH 里,手动加一行到 shell 启动文件(~/.bashrc / ~/.zshrc):

export PATH="$(npm prefix -g)/bin:$PATH"

保存执行source ~/.bashrc。

(2)sharp、node-gyp 相关编译错误

sharp: Please add node-gyp to your dependencies

sharp: Installation error

可以优先尝试用官方推荐的环境变量,让它走预编译包:

SHARP_IGNORE_GLOBAL_LIBVIPS=1 npm install -g openclaw@latest

(3) Docker 里服务起不来。

- 检查 Docker 是否在运行:

sudo systemctl status docker

- 看容器日志:

docker logs -f openclaw

- 如果是端口冲突(8080 被占用)的话,可以修改映射端口:

docker run -d \

--name openclaw \

-p 18080:8080 \

...

然后用 http://localhost:18080 访问。

六、onboard 配置向导

openclaw onboard 是 OpenClaw 自带的 交互式新手引导向导,会一步步问几个关键问题,然后自动生成一份完整可用的配置文件(~/.openclaw/openclaw.json),顺带把服务也拉起来。

大致会帮做这几件事:

- 检查 Node 版本、一些必须的依赖是否就绪;

- 打算先用哪种大模型(云端 API 还是本地模型);

- 希望在哪个聊天工具里跟 OpenClaw 对话(Telegram / 飞书 / QQ / Web UI 等);

- 要不要顺手安装一批常用技能(Skills),让它会操作文件、跑命令、发邮件等;

- 把这些选择写进统一配置文件,并根据需要帮启动守护进程 / 网关。

新手和多数个人用户,都应该先跑一遍 onboard,后面再按需在配置文件里微调。

直接执行:

openclaw onboard --install-daemon

接下来终端会出现一连串提问,只要:

- 用左、右、上、下箭头键选择选项;

- 或者直接回车接受默认值;

- 个别地方要手动粘贴 API Key / Bot Token。

不想一上来就配置各种聊天工具、技能,也可以优先把 模型接通 + 基础网关 配好;聊天通道和 Skills 可以先留空,等用顺手了再回来补。

下面就是在 onboard 的一个标准流程:

◇ I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue?

│ Yes

│

◇ Onboarding mode

│ QuickStart

│

◇ Config handling

│ Use existing values

│

◇ Model/auth provider

│ ○ OpenAI

│ ○ Anthropic

│ ○ Chutes

│ ○ vLLM

│ ○ MiniMax

│ ○ Moonshot AI (Kimi K2.5)

│ ○ Google

│ ○ xAI (Grok)

│ ○ Mistral AI

│ ○ Volcano Engine

│ ○ BytePlus

│ ○ OpenRouter

│ ○ Kilo Gateway

│ ● Qwen (OAuth)

│ ○ Z.AI

│ ○ Qianfan

│ ○ Copilot

│ ○ Vercel AI Gateway

│ ○ OpenCode Zen

│ ○ Xiaomi

│ ○ Synthetic

│ ○ Together AI

│ ○ Hugging Face

│ ○ Venice AI

│ ...

│

◇ Filter models by provider

│ qwen-portal

│

◇ Default model

│ Keep current (qwen-portal/coder-model)

│

◇ Select channel (QuickStart)

│ Skip for now

│

◇ Search provider

│ Skip for now

│

◇ Configure skills now? (recommended)

│ No

│

◇ Enable hooks?

│ Skip for now

│

◇ Gateway service already installed

│ Restart

│

└ Onboarding complete. Use the dashboard link above to control OpenClaw.

注意,选择QWen的时候,要复制下面的地址到浏览器去授权(注册登录Qwen的账户)。

◇ Model/auth provider

│ Qwen

│

◐ Starting Qwen OAuth…│

◇ Qwen OAuth ─────────────────────────────────────────────────────────────────────────╮

│ │

│ Open https://chat.qwen.ai/authorize?user_code=JYLTVQJ3&client=qwen-code to approve │

│ access. │

│ If prompted, enter the code JYLTVQJ3. │

│ │

├──────────────────────────────────────────────────────────────────────────────────────╯

认证授权界面:

跑完 onboard 之后,用命令确认一下:

openclaw --version # 看看版本号,有就行

openclaw doctor # 环境自检,有 WARN 正常,别出现 FATAL

openclaw status # 看守护进程 / 网关是否 running

如果都显示正常,基本说明链路已经是通的。

七、两种常见模型接入方式

OpenClaw 支持两大类模型接入方式:

- 云端模型:托管在厂商云上,通过 API 调用。

- 本地模型:把模型权重下载到自己机器,完全本地推理。

推荐新手、个人用户、轻量团队,先用云端模型 + 免费额度起步,后面再考虑本地模型或付费大模型。

| 维度 | 云端模型 | 本地模型 |

|---|---|---|

| 部署难度 | 低:只要有 API Key | 高:要下权重、配推理服务 |

| 对硬件要求 | 很低:2 ~ 4 GB 内存就够用 | 高:至少 16 ~ 32 GB 内存,甚至要 GPU |

| 成本结构 | 前期便宜,有免费额度,但长期要算 token 钱 | 前期要买机器、配环境,后续算力成本自己承担 |

| 隐私 & 合规 | 取决云厂商协议和地区 | 可完全内网、数据不出机房 |

| 适合人群 | 新手、个人、小团队、快速验证 | 有一定运维能力、对隐私或离线要求高的团队 |

建议:第一次养虾 优先选云端模型,尤其是有免费额度的版本。跑顺、跑熟之后,再考虑本地模型或混合方案(云端 + 本地)。

很多云模型厂商都会提供「免费试用」或「开发者免费额度」,足够把 OpenClaw 串起来并做一轮完整体验。

| 场景 | 推荐选择 | 说明 |

|---|---|---|

| 快速尝鲜,能科学上网 | OpenAI 免费额度 | 文本质量好,生态成熟,教程多 |

| 国内网络、少折腾网络 | 通义千问(Qwen,阿里云)、DeepSeek 等 | 有针对国内用户的免费额度和文档 |

| 同时试多个模型比较效果 | 一个主力 + 一个备用 | 在 OpenClaw 里配置默认 + fallback |

已经完成 onboard,只是后面想换模型 / 加模型,可以直接改配置文件。

打开:

vi ~/.openclaw/openclaw.json

用通义千问(Qwen 免费额度)

{

"mode": "gateway",

"model": {

"provider": "qwen",

"model": "qwen-plus",

"api_key": "QwenKey",

"api_endpoint": "https://dashscope.aliyuncs.com/compatible-mode/v1",

"temperature": 0.3

}

}

本地模型(Ollama)参考官方安装方式!

macOS/Linux:

curl -fsSL https://ollama.com/install.sh | sh

Windows PowerShell:

irm https://ollama.com/install.ps1 | iex

安装后验证:

ollama -v

然后拉取一个模型,比如通义千问 7B 版或 Mistral:

ollama pull qwen:7b

# 或

ollama pull mistral

然后在 OpenClaw 的 onboard / configure 中选择 “Ollama Provider”,并填:

- Provider:

ollama - Model:

qwen:7b

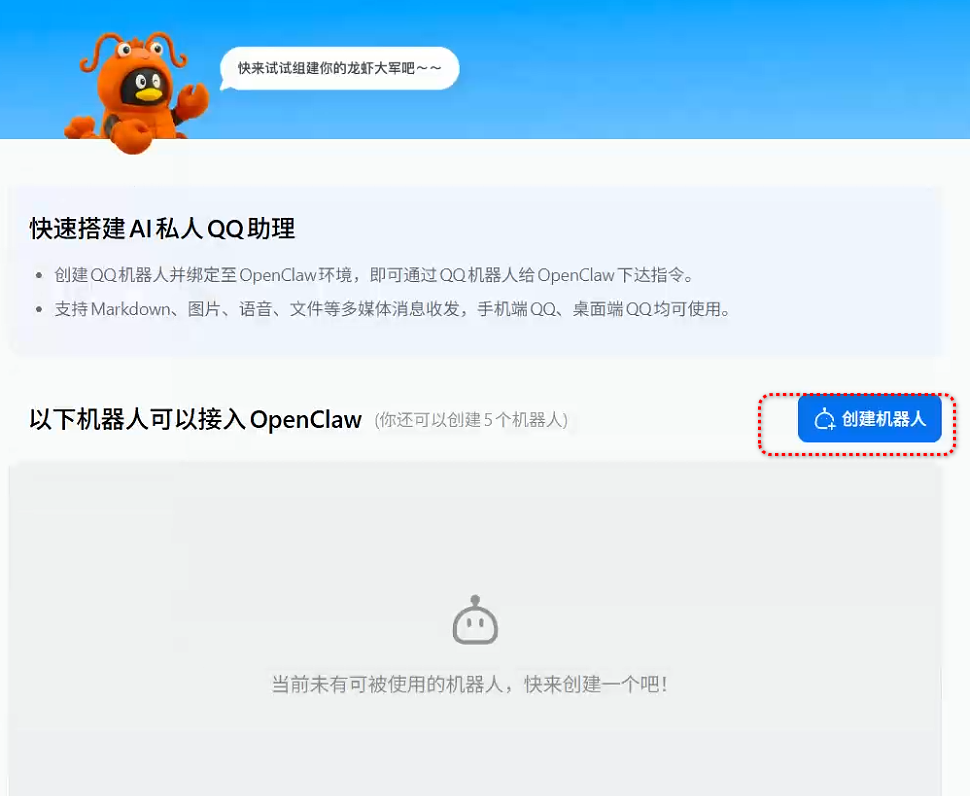

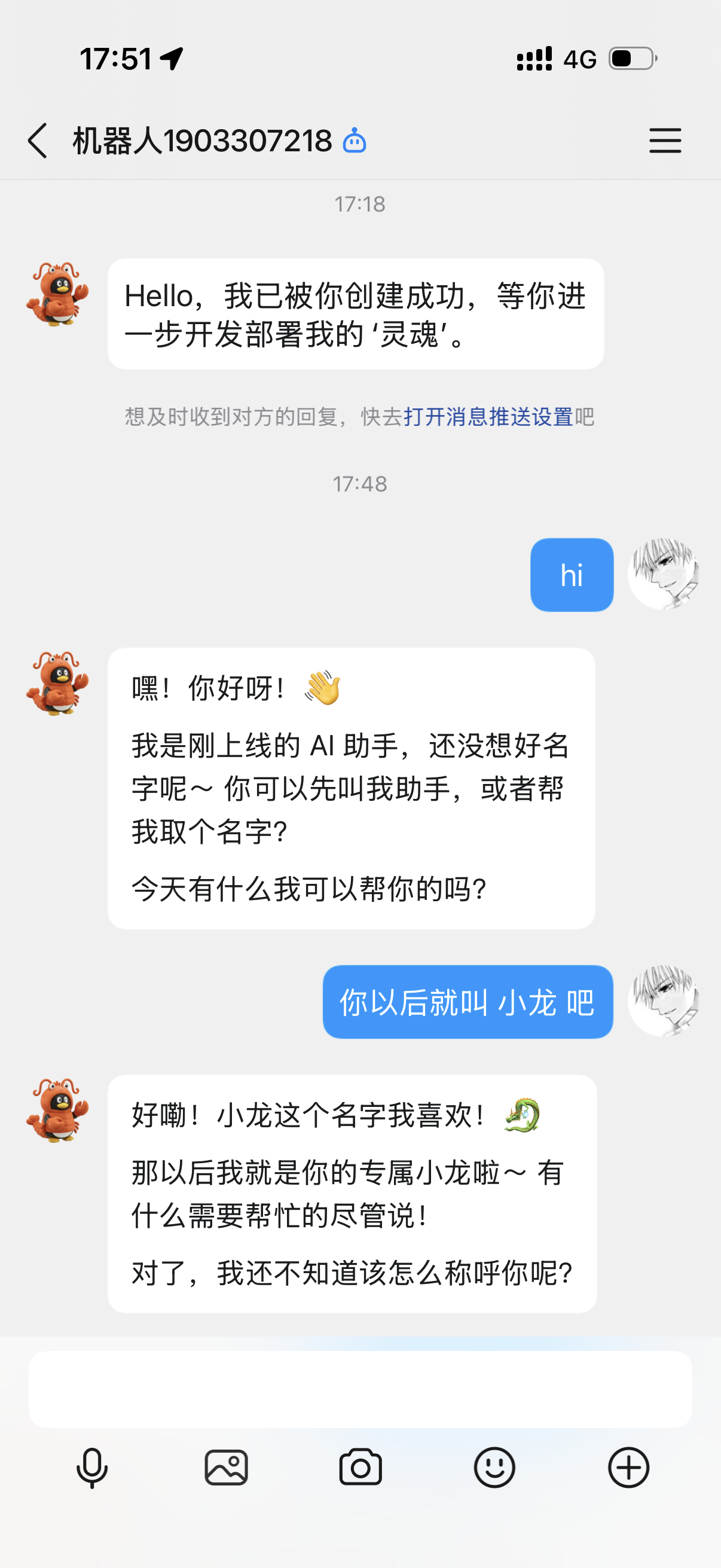

八、QQ 接入 OpenClaw

开浏览器输入QQ开放平台,直接QQ扫码登录。

然后创建机器人。

创建完成后,出现下面的提示接入流程,按照页面上的指引复制到终端就可以了,最好是点 扫码聊天,把机器人添加到QQ上。

按照指引复制配置信息到终端:

# 安装QQ机器人插件

openclaw plugins install @sliverp/qqbot@latest

# 添加QQ频道(替换为你的AppID和AppSecret)

openclaw channels add --channel qqbot --token "你的AppID:你的AppSecret"

# 重启网关

openclaw gateway restart

之后,就可以在 QQ 给OpenClaw发指令啦!

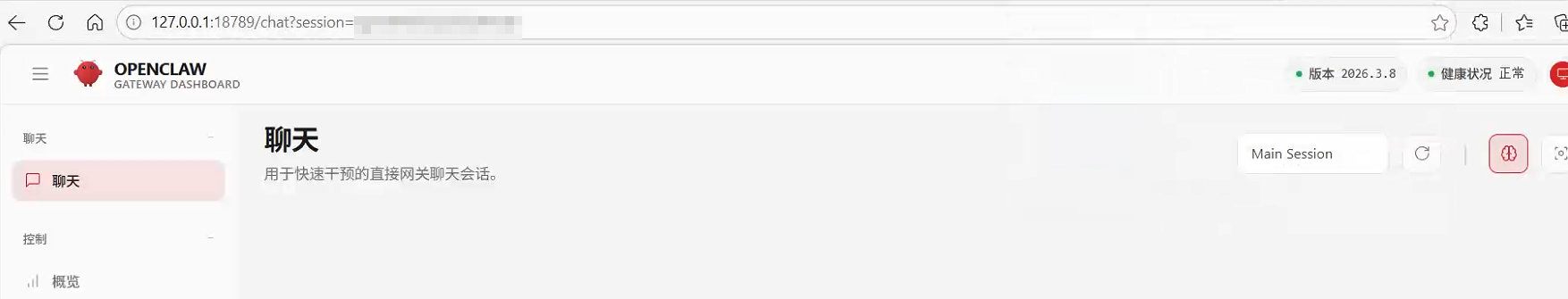

官方推荐先用本地 Web 控制台,不用一开始就折腾 通讯软件:

openclaw dashboard

然后浏览器打开:

http://127.0.0.1:18789/

如果能看到一个 Web 界面:

九、结语

到这里,已经完成了:

- 搭好运行环境(Node.js + Git)

- 安装好 OpenClaw 主程序

- 通过 onboard 配好基本网关

- 接上一个大模型和一个聊天入口

这只“小龙虾”已经可以帮你干活:

- 整理桌面和文件夹

- 每天定时发日报 / 周报草稿

- 把邮箱未读整理成摘要

- 自动从网页抓数据、整理成表格

后面想进一步折腾技能(Skills)、多通道融合、自动化流程,可以再去看更进阶的教程;但就“从 0 到成功把小龙虾养活”这一点,已经可以了。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)